Page des tutoriels

Table des matières

Prérequis

Sources

Si l'on souhaite se mettre au traitement des images en provenance des rovers posés à la surface de Mars, encore faut-il savoir où les chercher. Chaque mission possède son site officiel, hébergé par la NASA et le JPL, où les images sont disponibles gratuitement et librement. Cela date de l'époque de Mars Pathfinder où l'Internet a permis la diffusion de ses images à travers le monde.

Les deux missions actuellement en cours sont Opportunity et Curiosity. Pour chaque page d'images raw (ou brutes), les images sont rangées selon la caméra de provenance, puis du Sol (le jour de la mission).

Leurs images sont accessibles via les vignettes ci-dessous :

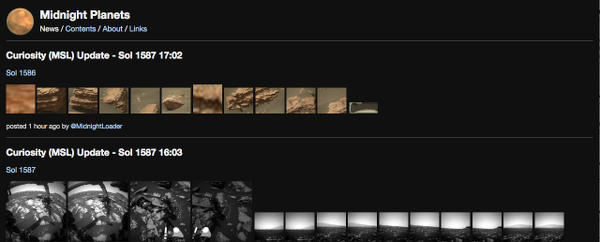

Mais il existe un autre site qui centralise toutes les images des trois rovers (Spirit, Opportunity et Curiosity), c'est Midnight Planets, qui possède la qualité d'être léger, clair et rapide. Et pour celleux qui voudraient aller plus loin, il existe le logiciel du même nom, qui permet d'explorer les images sous la forme d'une visite immersive.

Donc, pour Midnight Planets, c'est par là :

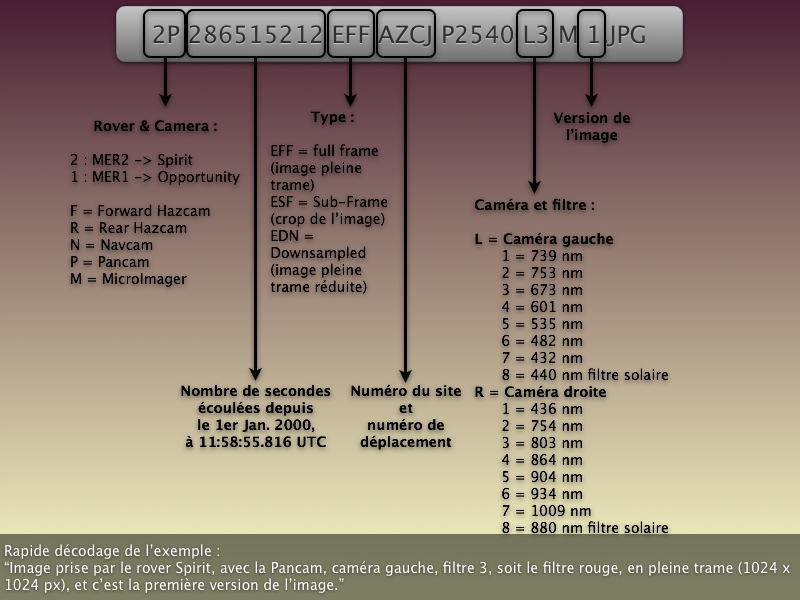

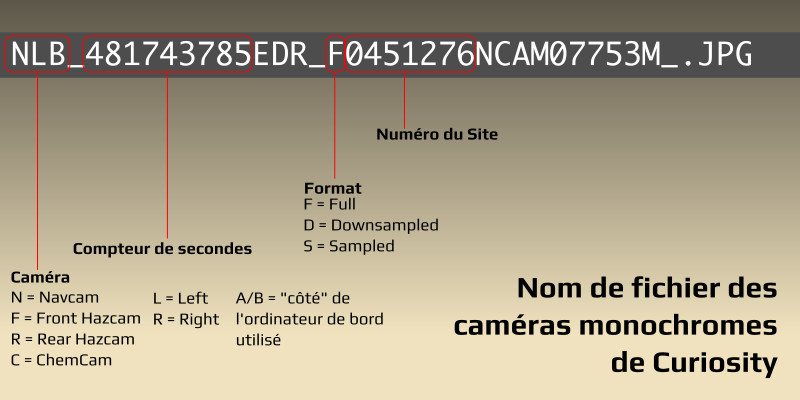

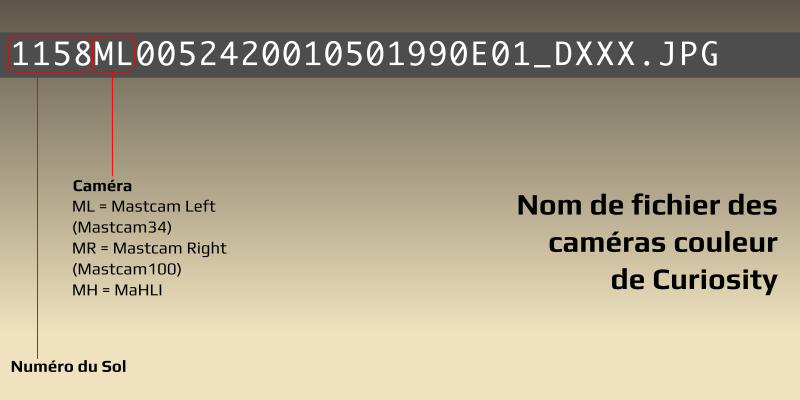

Vous constaterez que chaque image possède un nom de fichier plutôt long, et composé de lettres et de chiffres. Tout cela veut dire quelque chose. Voici une planche pour vous y aider. Dans les tutoriels, nous verrons de façon plus précise la partie conçernant les filtres. J'ai volontairement séparés les différents éléments du nom de fichier pour les mettre en évidence.

Voici la table de décodage pour les images Pancam provenant de Spirit et Opportunity :

Et pour Curiosity :

Cela dit, vous n'aurez pas besoin de connaitre par coeur la signification du code. Tout au plus, il convient de bien connaître si c'est la caméra droite ou gauche qui a pris l'image, et quel filtre, le cas échéant.

Enfin, il vous faudra deux logiciels essentiels, avec lesquels je travaille pour créer mes panoramas et images en couleur. Il s'agit de Gimp et Hugin. Ils sont libres et gratuits et ne nécessitent donc pas de licences. Super, non? De plus, ils sont tous les deux multiplateforme : c'est-à-dire que Gimp et Hugin sont portés sous Windows, Mac et toutes les distributions de Linux (fourni d'ailleurs par défaut sous Linux). Que demander de plus?

Cliquer sur la petite icône pour aller sur les pages de téléchargement.

Qu'est-ce qu'une caméra CCD ?

Vous pouvez visionnez ce court diaporama qui explique les principes de base d'une caméra CCD (ou CMOS par ailleurs).

Pour recharger le diaporama, actualisez la page.

Panoramas

Choses à savoir

Je vais aborder ici plusieurs problèmes récurents à connaître quand on veut avoir une bonne maîtrise de la production de panoramas.

Tout d'abord, il faut savoir que les caméras qui nous intéressent le plus (Pancam, Navcam et Mastcam) sont montées sur un mât et une tête rotative, pouvant exécuter des vues selon la déclinaison et l'azimuth.

Seulement, les choses seraient simples si le centre optique de chaque caméra coïncidait avec le centre de rotation du mât. Ce qui est faux car pour les besoins de la stéréoscopie, les caméras sont déportées de chaque côté de la tête du mât. Ainsi, à chaque prise de vue, entre deux rotations, les éléments en avant plan seront décalés du fait de la parallaxe (phénomène de décallage).

Deux autres choses viennent compliquer la mise en place d'un panorama homogène :

L'exposition tout d'abord.

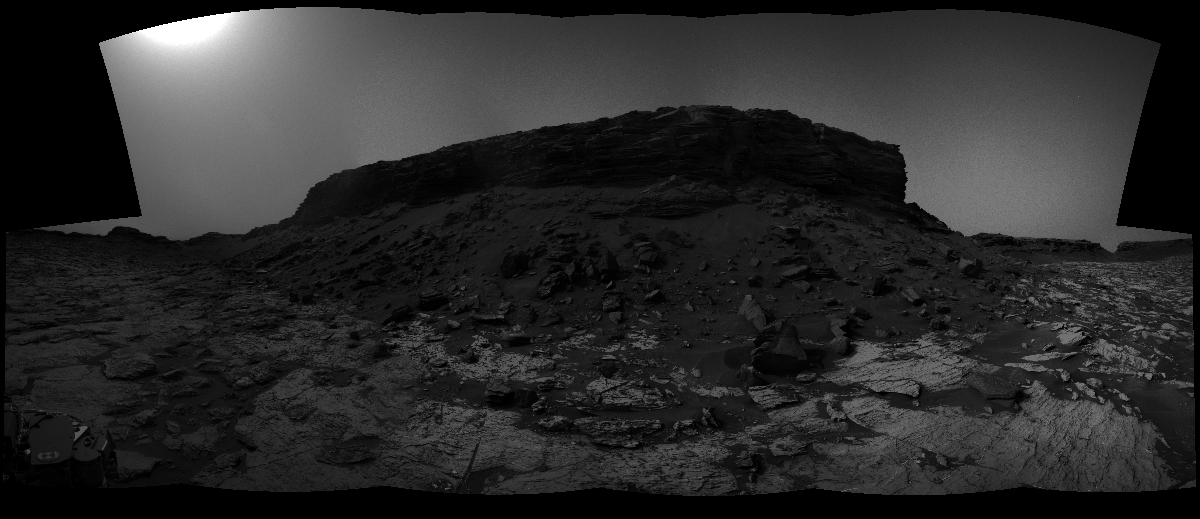

Nous allons prendre le cas extrême mais pas si rare que ça où un panorama est acquis avec un Soleil bas. Quand des vues sont faites en direction du Soleil, le paysage au premier plan sera sombre et le ciel clair, voire surexposé. Cela conduira à des vues de cette sorte :

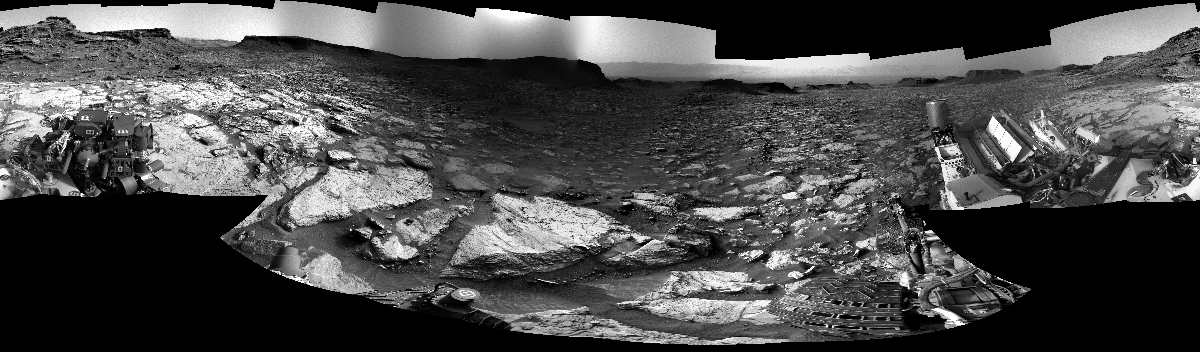

A l'inverse, des vues executées à l'opposé du Soleil seront claires et pourraient manquer de contraste. Si l'on ne corrige pas notre panorama de l'exposition, on obtiendra un résultat sensiblement identique à celui-ci :

Lorsque l'on composera notre panorama, il faudra bien veiller à corriger l'exposition de chaque image pour une résultat homogène. Aussi, il faudra jouer avec le contraste pour avoir des ombres débouchées.

Le vignettage

Cette aberration optique affecte la quasi-totalité des caméras et appareils photos. Cela provient des parties optiques qui absorbent une partie de la lumière, surtout sur le pourtour de celle-ci. Il en résulte un léger assombrissement sur les bords des images, qui peut se voir nettement sur les panoramas (tâches claires et sombres).

Dans la plupart des cas, on peut corriger ce vignettage, soit par l'utilisation d'une image que l'on appelle Flatfield, soit par un antivignettage logiciel. C'est la seconde méthode que nous utiliserons ici.

Tutoriel

Histoire que nous soyons sur un pied d'égalité, nous allons travailler sur un panorama que je n'ai pas encore travaillé au moment où je tape ces mots.

Vous trouverez un fichier compressé contenant les images nécessaires à la démonstration, ainsi qu'un fichier en PDF, contenant le tutoriel, expliqué étape par étape.

Le travail sera effectué sur des images Navcam du Sol 1584, du rover Curiosity. Nous travaillerons avec la version 2012.0.0 de Hugin (la dernière mise à jour n'étant pas suffisante).

Imagerie couleur

Qu'est-ce que la couleur ?

Nous voici donc dans "le vif" du sujet. Les couleurs de Mars.

Nous allons donc apprendre à mettre en couleurs les images fournies par les sondes Spirit, Opportunity et Curiosity. Mais avant de débuter, et surtout pour que puissiez traiter de façon intelligente les images des rovers, il vous faudra passer par quelques explications nécessaires.

Cela dit, si vous avez déjà de bonnes connaissances à ce sujet, vous pouvez sauter ce passage et aller directement aux tutoriels.

Une des plus anciennes expériences consistait à exposer un faisceau de lumière solaire à un prisme, objet en verre faisant office de renvoi coudé dans certains optiques (jumelles, lunettes astronomiques). C'est une belle image, populaire, que de prendre le prisme pour expliquer la nature colorée de la lumière, tout comme sur cet album des Pink Floyd, Dark Side Of The Moon :

Décomposée, la lumière blanche visible ressemble à ceci :

Nous avons vu que dans les noms de fichiers de images brutes de rovers, il y a des filtres coloré utilisés pour la Pancam, et que ceux-ci correspondent à une longueur d'onde, exprimée en nanomètres (nm), mais qu'est-ce donc?

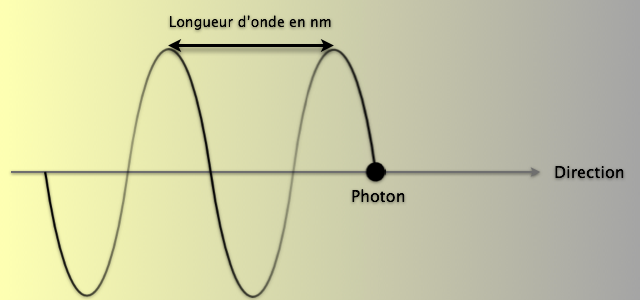

Il faut savoir d'abord concrètement ce qu'est la lumière, ce dont elle est constituée. La lumières est portée par des particules que l'on appelle "photons". Ceux-ci traversent un espace à la vitesse de 300 000 kilomètres par secondes. C'est la vitesse de la lumière. Mais vue de plus près, de beaucoup plus près, ces photons ne se déplacent pas en ligne droite, ils ondulent. L'onde correspondante peut-être décrite, selon sa longueur, c'est à dire la distance entre chaque "crête". Ce schéma explicatif pour mieux visualiser :

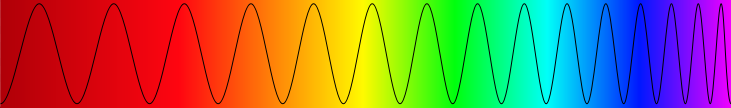

Mais ces photons n'ondulent pas tous de la même façon. Certains plutôt flemmards forment de larges vagues, d'autres au contraire, très nerveux, font des vagues très serrées. Cela a un lien direct avec la couleur qui leur correspond. En fait, plus l'on va vers le rouge, plus la longueur d'onde augmente, et plus l'on va vers le violet, plus celle-ci diminue. Basiquement, cela ressemble à ceci :

Le spectre visible commence à partir de 745 nm (rouge profond) et finit à 400 nm (violet sombre). En deçà du rouge nous avons les infra-rouges, et au delà du violet, nous avons les ultra-violets. C'est bête comme chou, non?

Imagerie couleur Pancam

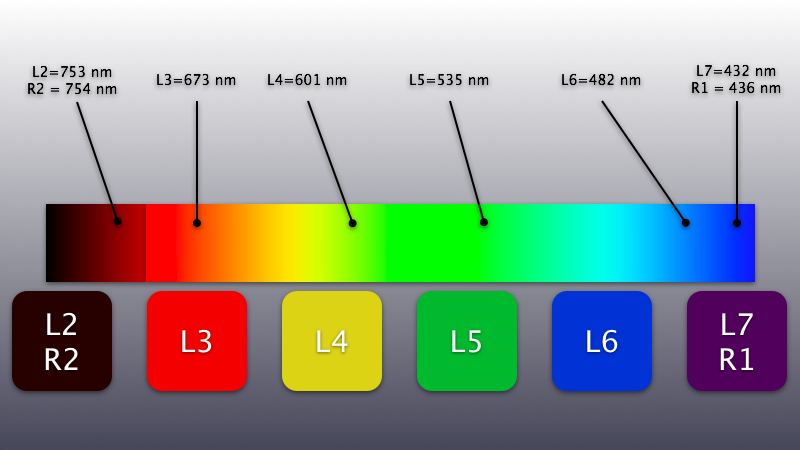

Les caméras Pancam sont donc équipées de roues à filtres colorés, qui servent à l'acquisition d'images en couleur. Voici les longueurs d'onde correspondant à chaque filtre (cf.noms de fichiers).

Caméra gauche

Caméra droite

Nous, ce qui nous intéresse, c'est d'avoir des images en couleurs visible, c'est à dire, ce que l'oeil humain verrait sur Mars. Evacuons donc les longueurs d'onde correspondant au domaine de l'invisible qui va de 745 nm à 400 nm. Notre liste va ressembler maintenant à ceci :

Caméra gauche

Caméra droite

Nous gardons volontairement les filtres L2 et R2 car ce sont des filtres infrarouge proche, c'est à dire que cela a une influence légère sur la colorimétrie d'une image (saturation du rouge).

Maintenant, attribuons leur une couleur. Cela donnera une planche de la sorte, avec la couleur correspondant à chaque filtre :

Dans le monde fantastique des couleurs, l'obtention d'images s'obtient par mélange de couleurs dites primaires, des couleurs que l'on ne peut pas obtenir par le mélange d'autres couleurs. Mais cela dépend du domaine dans lequel on se place. Ainsi, si l'on se place dans la peinture, la pigmentation, les couleurs primaires seront le Cyan, le Magenta et le Jaune. Et le mode de mélange est un mode soustractif. Ainsi, pour obtenir du Vert, on va mélanger du Cyan et du Jaune. La soustraction des deux donnera du Vert. La soustraction des 3 couleurs primaires donne du Noir.

Dans le domaine de la lumière, de l'imagerie numérique, les couleurs primaires sont le Rouge, le Vert et le Bleu. Ces couleurs se mélangent de façon additive. Ainsi, pour Jaune, il faut additionner du Rouge et du Vert. L'addition des 3 couleurs primaires donnera du Blanc.

Pourquoi je vous parle de tout ça? Pour une raison évidente : nous allons mixer les images des rovers de la même façon, par addition, après y avoir appliqué une colorisation correspondant au filtre qui a servi lors de la prise de vue.

Tutoriels Pancam

Tout d'abord, il faut un prérequis : le pack de démonstration, qui est indispensable pour suivre les tutoriels.

Celui-ci contient :

Ainsi que le logiciel Gimp, prêt à travailler.

Donc tout d'abord le pack, disponible ici, sous forme de fichier zip (2.1 Mo) :

Ainsi que le pack spécifique couche R1 et R2 (2.8 Mo) :

Ensuite, vous avez du remarquer que j'ai écrit "tutoriels" avec S. En effet, il y en a plusieurs. Trois exactement. Le premier s'appelle "Tutoriel Couleurs" et donne les bases et la méthode pour coloriser une vue qui a été prise en filtres pleins, c'est à dire avec tous les filtres de la caméra, à savoir L2, L3, L4, L5, L6, L7. C'est la meilleure methode qui donne des résultats uniformes et qui du point de vue du traitement est assez évident. Et un deuxième tutoriel, que vous ne pourrez faire que si vous avez suivi la formation dans le premier, concerne une méthode de prise de vue vraiment plus fréquente chez les rovers : le L2, L5 et L7. Soit : infrarouge, vert, violet. Moins évidente, mais donnant de très bons résultats pour peu qu'on s'y attarde vraiment, et la façon de produire des images en couleurs avec cette méthode est expliquée dans le "Tutoriel-L257". Et le dernier, qui consiste à faire des images en couleur avec la caméra droite de Pancam, avec les filtres R1 et R2.

Bon, je fais long. Voici les tutoriels, au format PDF, comme toujours (pesant respectivement 4 Mo, 2.1 Mo et 1.3 Mo) :